В сегодняшнем быстро развивающемся цифровом ландшафте искусственный интеллект продолжает оставлять свой след в различных отраслях, революционизируя то, как мы живем и работаем. По мере того, как растет ожидание преобразующего воздействия ИИ во многих секторах, есть одна область, где его присутствие уже прочно закрепилось и стало незаменимым компонентом. Интеграция искусственного интеллекта в кибербезопасность — это уже не далекая мечта, а реальность, формирующая и укрепляющая нашу защиту от постоянно растущих и все более изощренных киберугроз, нависающих над цифровым миром.

В этой статье подробно рассматриваются различные типы ИИ, играющие ключевую роль в защите наших данных. Мы обсудим, как и где нейронные сети используются в целях безопасности, и обрисуем преимущества и ограничения использования нейронных сетей в кибербезопасности. Кроме того, мы рассмотрим тенденции, которые ИИ вскоре сформирует в кибербезопасности. Погрузитесь в нашу статью для информативного и увлекательного чтения!

Что такое искусственный интеллект?

Системы, основанные на правилах

Нейронные сети

Глубокие нейронные сети

Какие виды ИИ используются для обеспечения кибербезопасности?

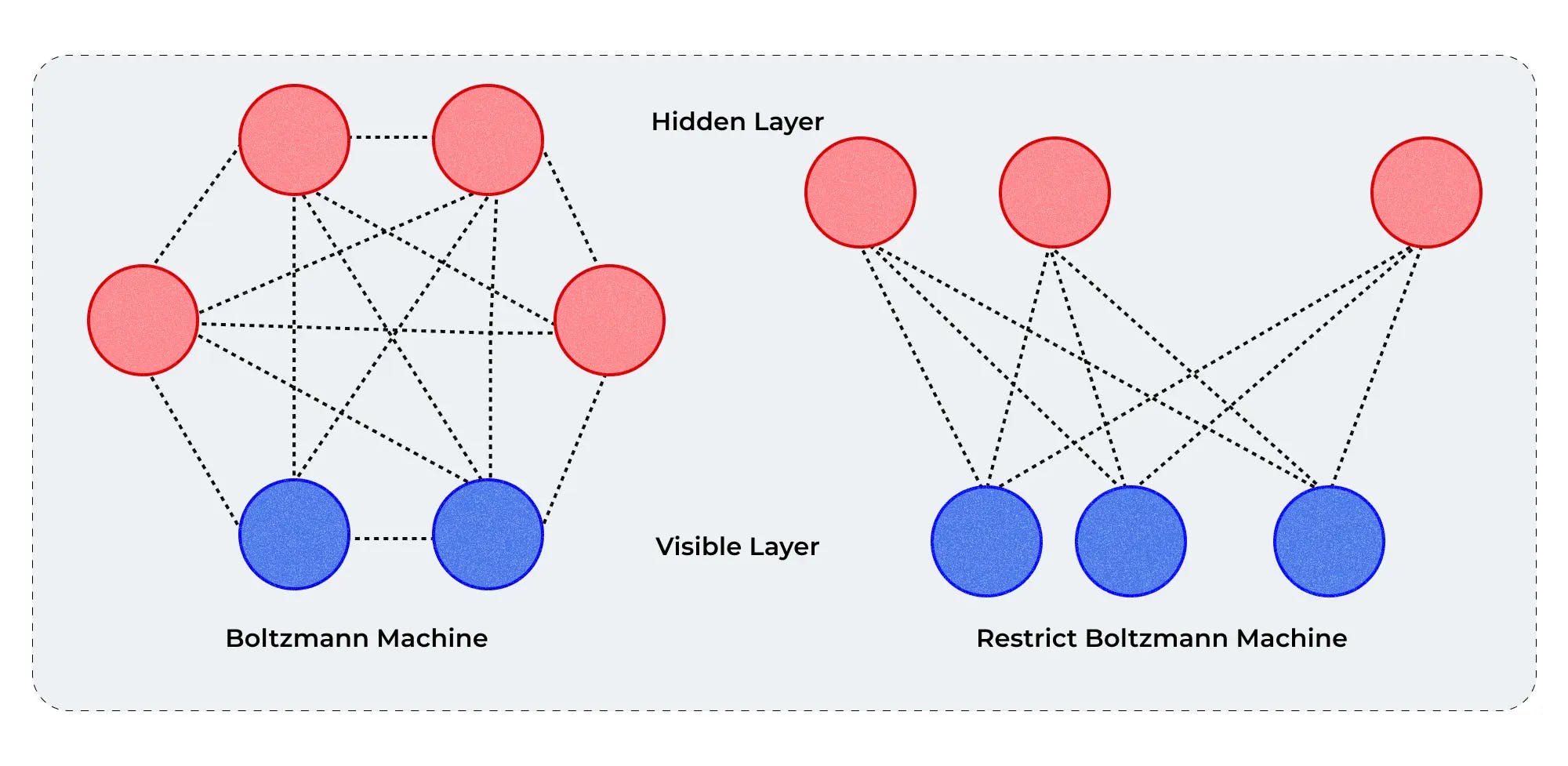

Генеративные нейронные сети (GNNS) — это тип искусственной нейронной сети, которая может генерировать новые точки данных, аналогичные тем, на которых они были обучены. Они предназначены для изучения базовой структуры данных, что позволяет им создавать реалистичные и разнообразные выборки.

Примерами GNNS являются вариационные автокодеры (VAEs) и ограниченные машины Больцмана (RBM). В кибербезопасности GNN в основном используются для расширения данных, обнаружения аномалий и моделирования кибератак. Генерируя новые точки данных, они помогают создавать надежные наборы данных для обучения других моделей машинного обучения.

GNNS также могут выявлять аномалии в сетевом трафике или поведении пользователей, сравнивая их с сгенерированными шаблонами данных. Кроме того, они могут имитировать различные сценарии атак для тестирования и повышения устойчивости систем кибербезопасности.

Состязательные нейронные сети

ANN относятся к обучению моделей машинного обучения противостоять атакам противника. Эти атаки включают в себя создание вредоносных входных данных, чтобы заставить модели делать неправильные прогнозы или классификации. ANN предназначены для повышения способности модели противостоять таким атакам путем включения неблагоприятных примеров в процесс обучения.

В кибербезопасности ANN используются для того, чтобы сделать модели машинного обучения более устойчивыми к атакам противника. Обучение моделей на неблагоприятных примерах делает их более устойчивыми к таким атакам и повышает общую безопасность. Этот подход особенно полезен в системах распознавания образов, NLP и обнаружения вторжений, где атаки злоумышленников могут иметь значительные последствия.

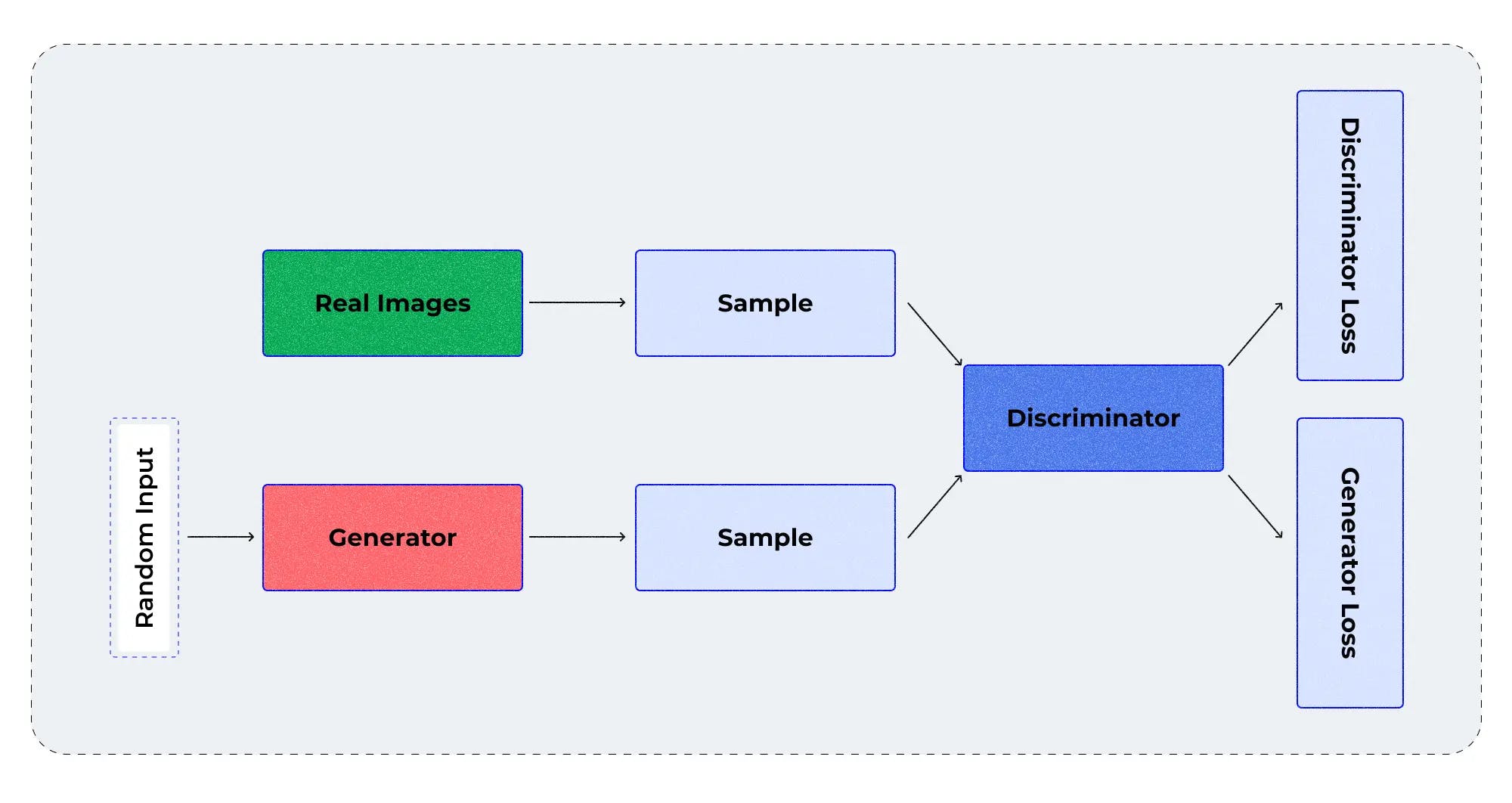

Генеративные состязательные сети (GAN) представляют собой уникальную архитектуру искусственного интеллекта, состоящую из двух конкурирующих нейронных сетей: генератора и дискриминатора. Генератор создает синтетические данные, в то время как дискриминатор оценивает их подлинность. Результатом этого соревнования становится все более реалистичная генерация данных с помощью различных приложений.

В области кибербезопасности GAN обладают рядом преимуществ. GAN позволяют расширять данные, обнаруживать уязвимости и имитировать атаки, улучшая общее обнаружение угроз и реагирование на них. GAN предоставляют ценную информацию, имитируя поведение киберпреступников, и позволяют организациям совершенствовать свои подходы к обеспечению безопасности.

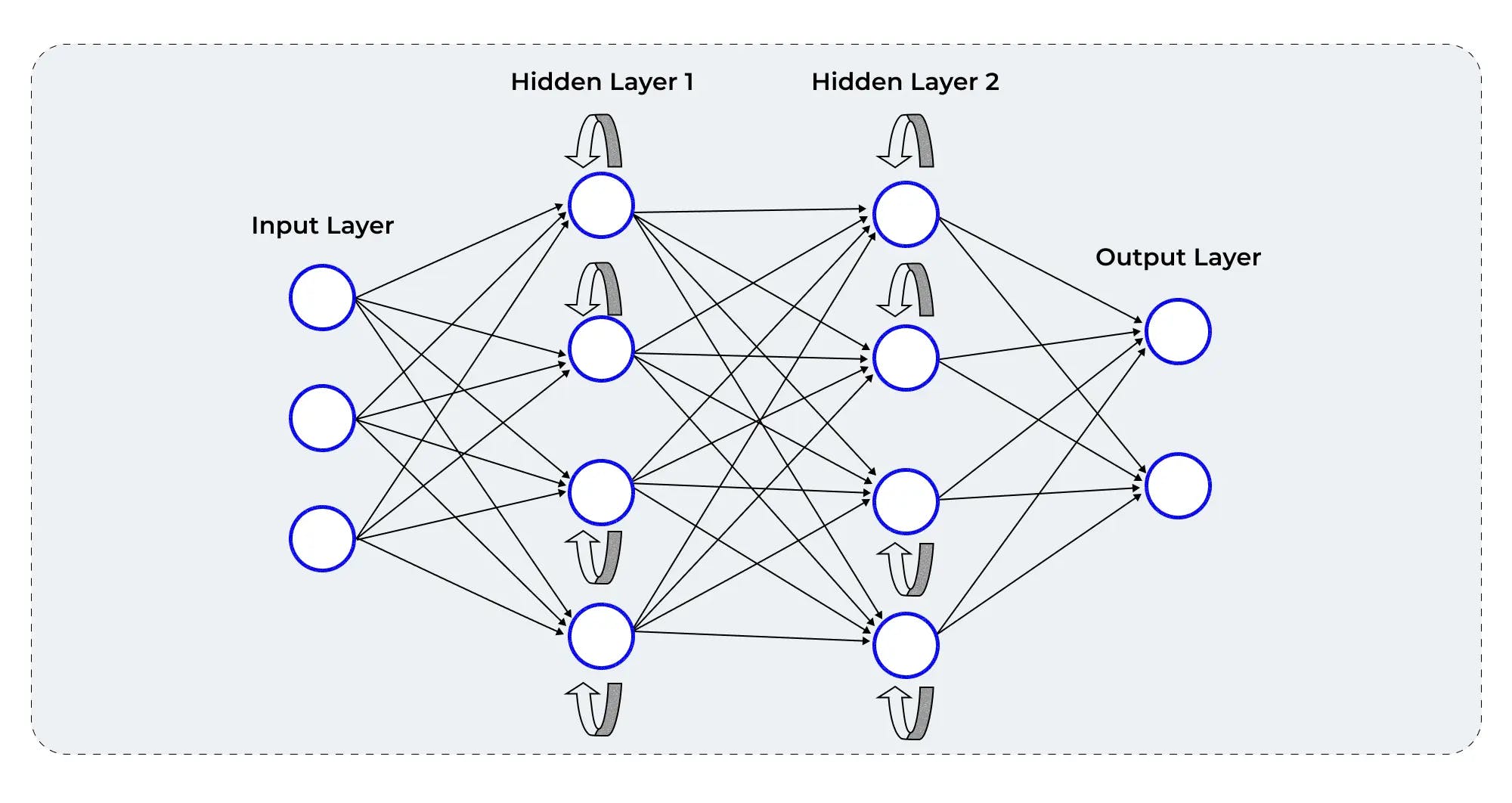

Рекуррентные нейронные сети (RNN) предназначены для обработки последовательных данных, что делает их особенно подходящими для анализа временных рядов или задач NLP.

Их уникальная архитектура позволяет им поддерживать скрытое состояние, выступая в качестве формы памяти. Это скрытое состояние позволяет RNN запоминать и использовать прошлые входные данные для лучшего прогнозирования будущих событий. RNNS могут определять закономерности и тенденции в потоках данных, помогая обнаруживать аномалии и потенциальные вторжения. Их способность обрабатывать последовательные данные позволяет им распознавать долгосрочные зависимости, способствуя раннему обнаружению кибератак и упреждающему смягчению последствий угрозы.

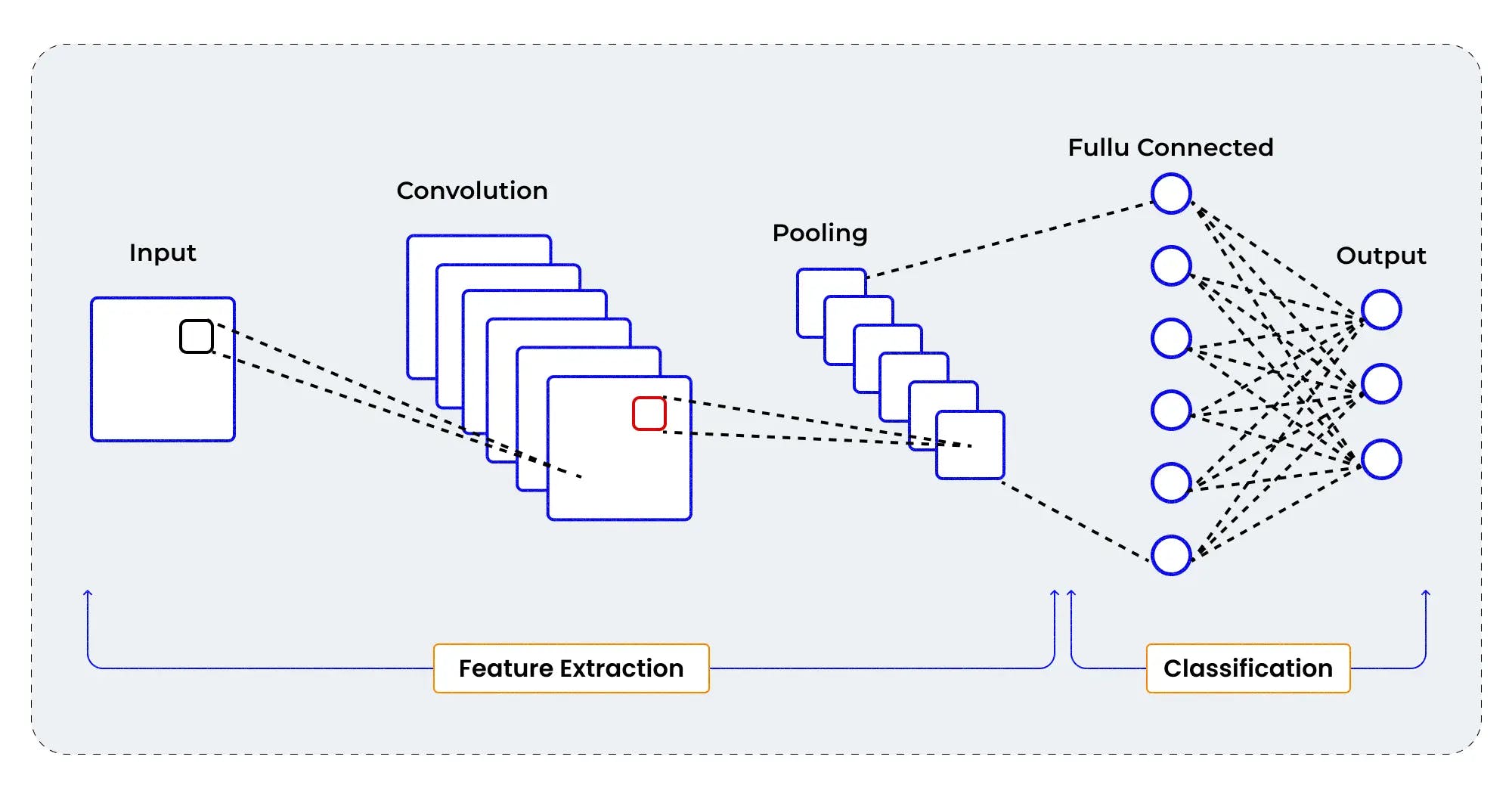

Сверточные нейронные сети (CNN) — это специализированные нейронные сети, предназначенные для обработки изображений и задач компьютерного зрения. Они используют метод, называемый сверткой, который включает в себя применение множества фильтров к входным данным для выявления конкретных функций или шаблонов. Этот процесс позволяет CNNs изучать иерархические представления входных данных, что делает их пригодными для задач, требующих распознавания сложных шаблонов.

Потому что CNN специализируются на распознавании образов и широко используются в кибербезопасности для таких задач, как обнаружение вредоносных программ и вторжений. Анализируя различные форматы файлов и выявляя отличительные закономерности, связанные с вредоносным контентом, CNNS могут точно обнаруживать ранее невидимые угрозы. Их способность обрабатывать большие объемы данных параллельно также делает их эффективными для обнаружения угроз в режиме реального времени и реагирования на них.

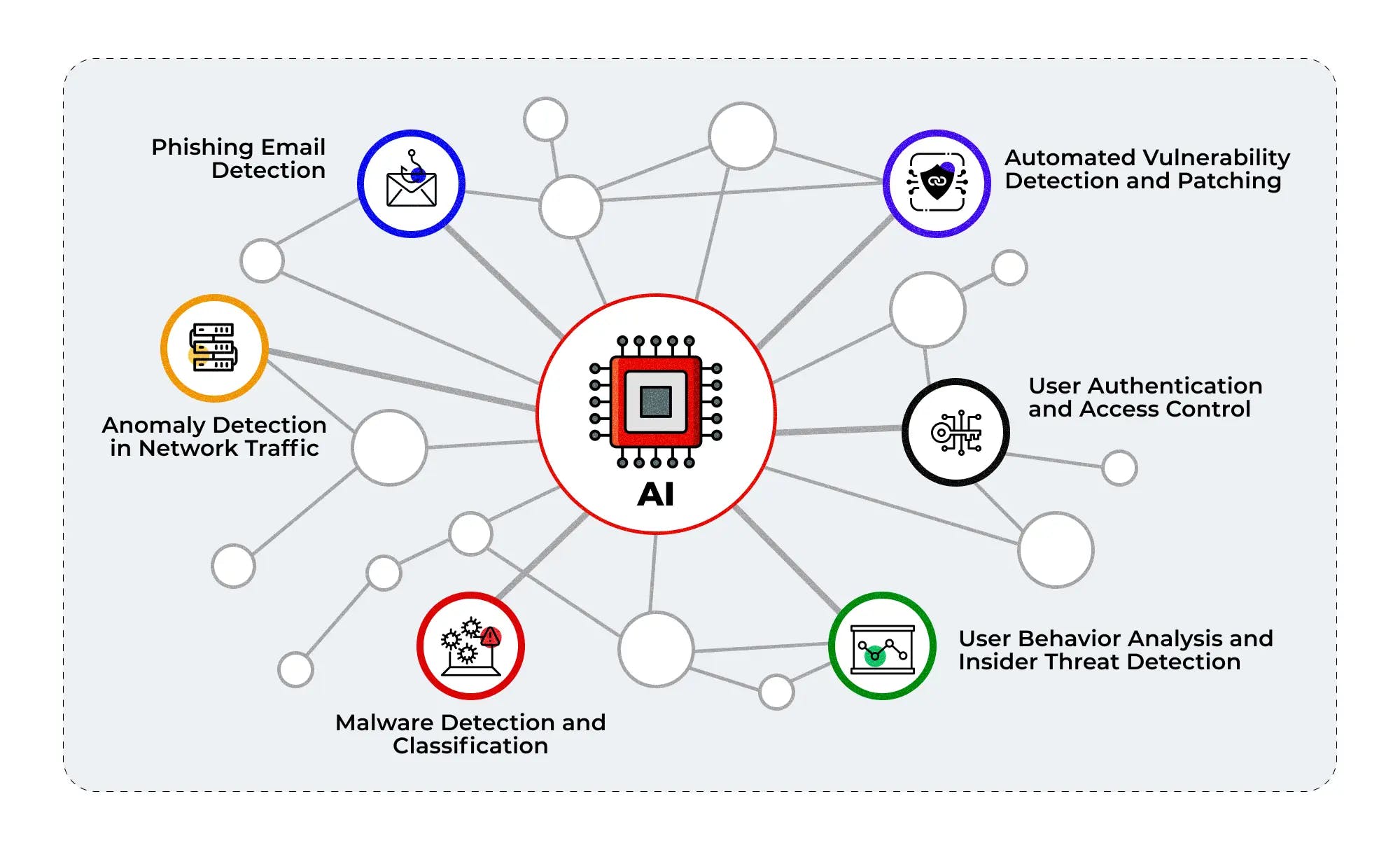

Примеры использования ИИ в кибербезопасности

Обнаружение аномалий в сетевом трафике

RNNS могут изучать обычные шаблоны и выявлять аномалии в режиме реального времени путем обработки данных сетевого трафика. Они могут выявлять потенциальные угрозы, такие как распределенные атаки типа «Отказ в обслуживании» (DDoS) или попытки утечки данных, позволяя группам безопасности оперативно реагировать и снижать риски. Способность RNNS адаптироваться к изменяющимся схемам трафика гарантирует, что они остаются эффективными даже при изменении условий сети или появлении новых угроз.

Обнаружение и классификация вредоносных программ

Организации могут повысить уровень своей безопасности, используя CNN для обнаружения вредоносных программ и снижая вероятность успешных атак или утечки данных. CNN обучаются работе с большими наборами данных доброкачественных и вредоносных файлов, учатся определять шаблоны и функции, связанные с вредоносным ПО. Затем они могут анализировать новые файлы и классифицировать их на основе их сходства с известными образцами вредоносных программ. Такой подход позволяет быстро и точно обнаруживать вредоносные программы даже при появлении новых вариантов.

Аутентификация пользователей и контроль доступа

CNNS можно использовать для биометрической аутентификации, такой как распознавание лиц или сканирование отпечатков пальцев. Эти сети могут анализировать визуальные данные и отличать авторизованных пользователей от злоумышленников. RNNS могут анализировать модели поведения пользователей, такие как динамика нажатия клавиш или движения мыши, создавая непрерывный и ненавязчивый механизм аутентификации. Это помогает идентифицировать неавторизованных пользователей даже после первоначального входа в систему путем мониторинга и оценки поведения пользователя на протяжении всего сеанса. GNNS можно использовать для моделирования взаимоотношений между пользователями, устройствами и ресурсами в сети, обеспечивая более детальный и контекстно-зависимый контроль доступа. Понимая сложные зависимости и взаимодействия организации, GNNS могут помочь идентифицировать необычные запросы на доступ или потенциальные угрозы безопасности, улучшая общее состояние безопасности.

Объединив сильные стороны CNNs, RNNS и GNNS, организации могут разработать многоуровневую систему аутентификации и контроля доступа, которая обеспечивает надежную защиту при одновременном снижении риска несанкционированного доступа и утечки данных.

Обнаружение фишинговой электронной почты

RNN полезны для анализа текстового содержимого электронных писем и поиска шаблонов и последовательностей, указывающих на попытки фишинга. Их можно обучить работе с большими наборами данных фишинговых и законных электронных писем, чтобы разработать модель, которая сможет эффективно различать их. Между тем CNNS можно использовать для анализа визуальных аспектов электронного письма, таких как встроенные изображения или логотипы, которые часто используются в фишинговых электронных письмах для имитации законных организаций.

Объединив сильные стороны RNNs и CNNs, можно разработать надежную систему обнаружения фишинговых электронных писем, которая анализирует как текстовые, так и визуальные элементы электронных писем, повышая точность и эффективность обнаружения фишинга и защиты от него.

Анализ поведения пользователей и обнаружение внутренних угроз

RNN анализируют последовательность действий пользователя, таких как доступ к файлам, попытки входа в систему или передачи данных, и учатся определять типичные модели поведения. GNNS генерируют новые точки данных на основе изученных шаблонов, помогая создать более четкое представление о нормальном поведении пользователя. Система может выявлять аномалии и отмечать потенциальные внутренние угрозы путем сравнения действий пользователей в режиме реального времени с ожидаемыми моделями поведения, генерируемыми GNNS.

Такой подход позволяет организациям активно реагировать на потенциальные угрозы безопасности и защищать свои конфиденциальные данные и системы.

Автоматическое обнаружение уязвимостей и исправление

RNNS можно использовать для обработки исходного кода приложений, анализа последовательности инструкций и обнаружения шаблонов, связанных с известными уязвимостями. Изучая большие наборы данных кода с известными уязвимостями, RNNS могут выявлять аналогичные проблемы в новых приложениях и предлагать возможные исправления. CNNS может применяться для анализа конфигурационных файлов, выявления неправильных конфигураций или небезопасных настроек, которые могут подвергнуть системы потенциальным атакам.

Автоматизируя этот процесс, организации могут снизить вероятность успешных атак, поддерживать надежную систему безопасности и повысить общую надежность системы.

- Более быстрое обнаружение основных уязвимостей. Решения, основанные на ИИ, могут быстро выявлять слабые места в системах, сокращая возможности для киберпреступников использовать эти уязвимости. Исследования показывают, что ИИ может сократить среднее время обнаружения уязвимостей с недель до простых часов или даже минут.

- Улучшенная идентификация рисков и обоснованные меры безопасности. Аналитика на базе искусственного интеллекта позволяет организациям глубже понимать свое состояние безопасности и внедрять целевые меры безопасности, основанные на данных.

- Круглосуточный мониторинг и смягчение последствий угроз. Инструменты кибербезопасности на основе искусственного интеллекта обеспечивают автоматический мониторинг в режиме 24/7 и могут значительно сократить среднее время реагирования на инциденты безопасности, позволяя организациям более эффективно предотвращать или ограничивать последствия взломов.

- Снижение нагрузки на специалистов по кибербезопасности. ИИ автоматизирует рутинные задачи, освобождая специалистов по безопасности для решения более сложных задач.

- Повышение эффективности и рентабельности. Решения в области кибербезопасности, основанные на искусственном интеллекте, оптимизируют процессы, сводят к минимуму человеческие ошибки и уменьшают зависимость от ручного труда.

- Улучшенное реагирование на инциденты. Инструменты на базе искусственного интеллекта могут анализировать инциденты безопасности и определять их приоритетность, позволяя организациям быстрее и эффективнее реагировать на нарушения.

- Масштабируемость и адаптивность. Решения для кибербезопасности на основе искусственного интеллекта могут адаптироваться и масштабироваться в соответствии с меняющимися потребностями бизнеса, обеспечивая более устойчивую и гибкую инфраструктуру безопасности, которая может расти вместе с организацией.

- Упреждающий поиск угроз. Решения, основанные на ИИ, могут активно искать потенциальные угрозы в цифровой среде организации, выявляя и устраняя риски до того, как они перерастут в полномасштабные атаки.

Ограничения использования ИИ в кибербезопасности

- ИИ не поможет справиться с уникальными угрозами. ИИ обычно обучается на исторических данных и шаблонах. В результате ему может быть трудно обнаруживать совершенно новые или очень сложные виды угроз, которые никогда раньше не встречались, и реагировать на них.

- ИИ не поможет вам найти креативные способы атаки на систему. Хотя ИИ может выявлять известные уязвимости и схемы атак, он может оказаться неэффективным при обнаружении новых векторов атак, требующих нестандартного мышления или человеческой изобретательности.

- Искусственный интеллект также является отличным новым инструментом для киберпреступников. По мере развития ИИ в области безопасности злоумышленники также могут использовать его для создания более мощных угроз, таких как разработка сложного вредоносного ПО или масштабная автоматизация атак. Это может привести к эскалации гонки вооружений между специалистами по кибербезопасности и киберпреступниками.

- Зависимость от качественных данных. Эффективность решений в области кибербезопасности, основанных на ИИ, в значительной степени зависит от качества и количества данных, используемых для обучения. Неточные или предвзятые данные могут привести к ложноположительным или негативным результатам, потенциально подрывая надежность системы.

- Конфиденциальность и этические соображения. Обширный сбор и анализ данных, необходимые для кибербезопасности на основе искусственного интеллекта, могут вызвать проблемы конфиденциальности и этики, особенно когда речь идет о конфиденциальной личной или организационной информации.

- Проблемы интеграции и совместимости. Внедрение решений на основе искусственного интеллекта в рамках существующих инфраструктур кибербезопасности может быть сложным, поскольку организациям необходимо обеспечить бесперебойную интеграцию и совместимость со своими текущими системами и процессами.

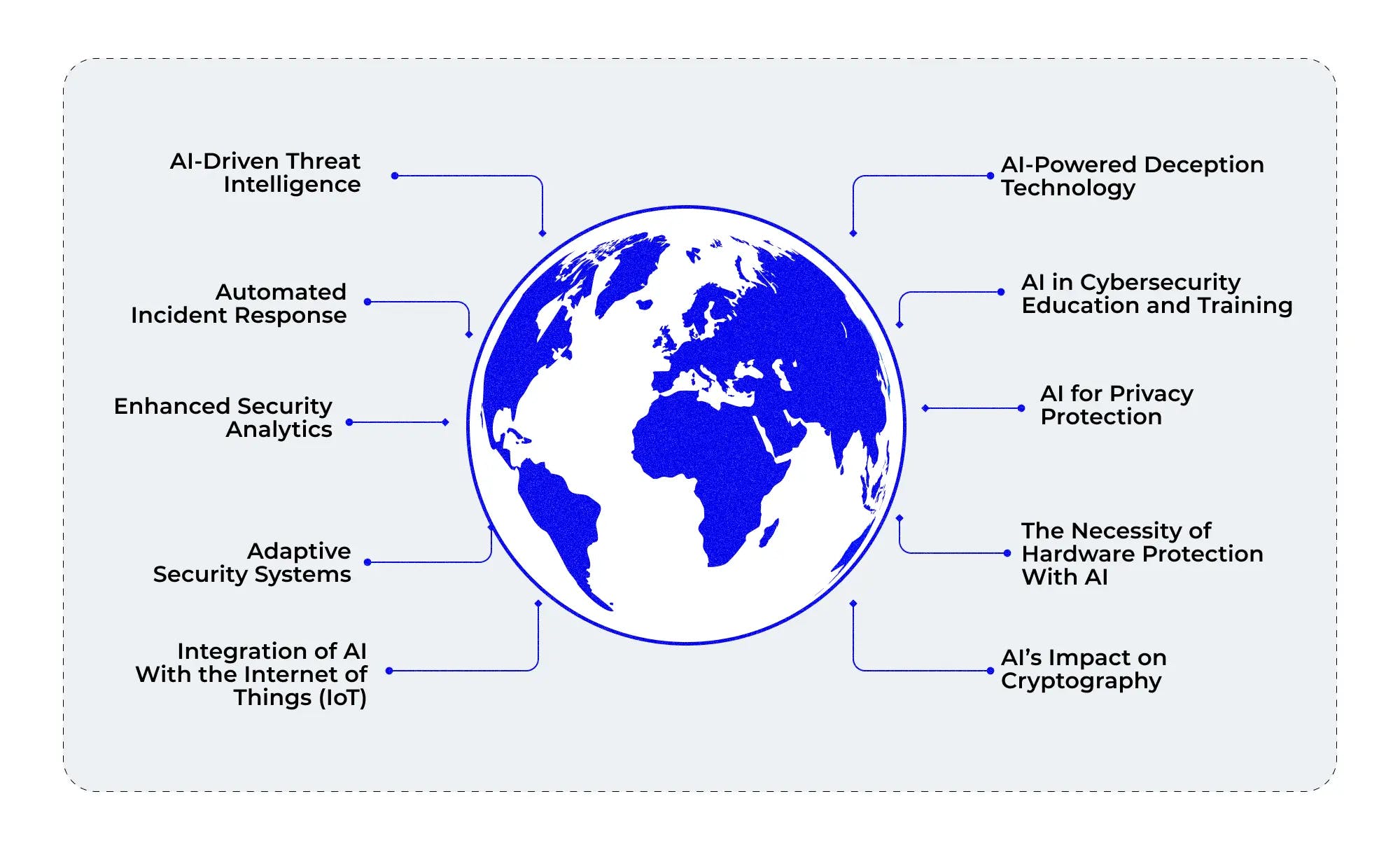

Анализ угроз на основе искусственного интеллекта

Автоматическое реагирование на инциденты

Расширенная аналитика безопасности

Адаптивные системы безопасности

Интеграция искусственного интеллекта с Интернетом вещей (IoT)

Технология обмана на базе искусственного интеллекта

Искусственный интеллект в образовании и профессиональной подготовке в области кибербезопасности

Искусственный интеллект для защиты частной жизни

Необходимость аппаратной защиты с помощью ИИ

Влияние ИИ на криптографию

Краткие сведения

Не следует опасаться ИИ как неоспоримого присутствия в данной области; скорее, его следует постоянно использовать и совершенствовать. Внедряя ИИ, мы позволяем экспертам-людям сосредоточиться на своих сильных сторонах, таких как решение сложных проблем и принятие важных решений. Адаптируясь к этому технологическому ландшафту, мы должны признать потенциал дальнейших инноваций в области кибербезопасности, его перспективность и его ограничения, разумно использовать его и активно развивать.